Ai observat vreodată că, după ce cauți o pereche de pantofi, Instagram începe brusc să-ți arate reclame doar la încălțăminte? Sau că după ce urmărești un videoclip despre o teorie ciudată, feed-ul tău se umple de „dovezi” care o susțin? Ești tentat să crezi că ești urmărit. Poate fi parțial adevărat, dar mai mult decât atât, ești filtrat.

Nu este vorba despre un complot, ci despre modul în care funcționează rețelele sociale și platformele online. Dacă vrem să rămânem informați și liberi în gândire, trebuie să înțelegem cum funcționează aceste mecanisme.

Ce este un algoritm și cum funcționează?

Un algoritm este, în esență, un set de reguli matematice sau logice care rezolvă o problemă sau ia o decizie. În cazul rețelelor sociale, algoritmii decid ce conținut ți se afișează, în ce ordine și cât de des.

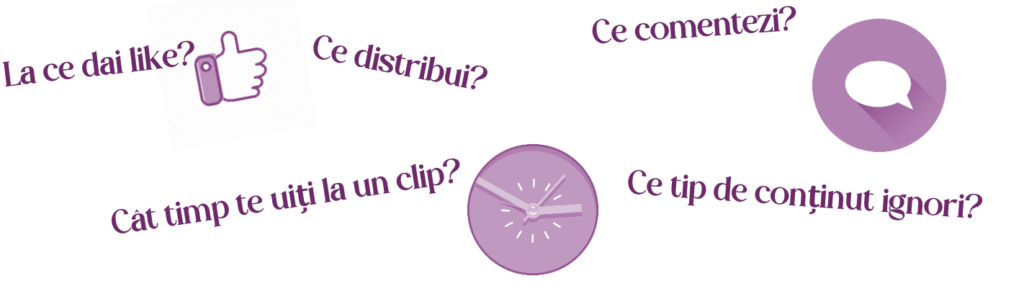

Fiecare platformă folosește un algoritm propriu, dar ideea de bază e simplă: să îți capteze atenția cât mai mult timp. Pentru a face asta, algoritmii învață din comportamentul tău:

Pe baza acestor informații, platforma încearcă să-ți ofere mai mult din ceea ce „te interesează”. Problema este că, în timp, ajungi să vezi doar acel tip de conținut, iar restul dispare din peisaj.

Cum ne afectează în mod real?

👉🏼 Te închide într-o bulă informațional

Termenul „filter bubble” descrie perfect ceea ce se întâmplă: ajungi într-o bulă în care totul îți confirmă ceea ce crezi deja. Nu mai vezi opinii diferite, nu mai ai acces la alte perspective, iar realitatea devine personalizată.

Un exemplu ar fi dacă te uiți la câteva videoclipuri care critică vaccinurile, algoritmul îți va oferi din ce în ce mai multe materiale antivaccin. Astfel, ajungi să crezi că „toată lumea” este împotriva vaccinării, deși realitatea este mult mai nuanțată.

Creează iluzia adevărului universal

Când vezi o idee repetată des și din mai multe surse, ai tendința să o crezi. Se numește efectul de familiaritate: creierul nostru asociază frecvența cu adevărul.

Astfel, algoritmii pot transforma opinii sau teorii neverificate în convingeri puternice, doar pentru că le vezi mereu. Și mai grav e că nu realizezi că alegerea nu a fost a ta, ci a unui cod scris de cineva care nu te cunoaște.

Când devine o opinie periculoasă?

Internetul ne dă libertatea să ne exprimăm, dar această libertate vine și cu o responsabilitate uriașă, cum ne alegem informațiile?

Dacă algoritmul te hrănește zilnic cu un singur punct de vedere, poți ajunge să:

Un caz real a fost în 2020, în timpul pandemiei, sute de tineri au început să creadă că virusul nu există, influențați de clipuri virale care susțineau această idee. Mulți au refuzat să poarte mască sau să respecte regulile de siguranță. Unele familii au plătit prețul greu, pentru că au ajuns să creadă mai mult în videoclipurile de pe TikTok decât în medici.

Cât de personalizat e feed-ul tău? Testează-te.

Răspunde cu „DA” sau „NU”:

- Ai impresia că pe internet „toată lumea” gândește ca tine?

- Îți vin des în feed videoclipuri cu opinii asemănătoare?

- Când cauți un subiect nou, primești automat variante care îți confirmă părerea?

- Ai distribuit vreodată o postare fără să verifici sursa, pentru că „era peste tot”?

- Te simți ciudat când cineva are o opinie complet diferită?

Dacă ai răspuns „DA” la cel puțin 3 întrebări, e un semn clar că algoritmii îți filtrează realitatea mai mult decât crezi.

6 pași simpli pentru a evităm manipularea algoritmică

1. Diversifică-ți sursele

Nu te baza doar pe TikTok sau Instagram. Citește articole, uită-te la documentare, urmărește canale educative pe YouTube, ascultă podcasturi. Nu toate trebuie să fie de acord cu tine.

2. Verifică sursa

Când vezi o informație „bombă”, întreabă-te:

– Cine a scris asta?

– E o sursă cunoscută?

– Există date care o susțin?

3. Nu te grăbi să distribui

Dacă ceva îți trezește o reacție puternică (furie, entuziasm, panică), e posibil să fie făcut tocmai pentru a atrage atenția. Gândește înainte să distribui.

4. Curăță-ți feed-ul

Urmărește și alte tipuri de conturi, educaționale, științifice, jurnalistice. Caută conținut care te provoacă să gândești, nu doar să reacționezi.

5. Discută cu oameni din afara „bulei” tale

Poartă conversații reale cu oameni care nu gândesc ca tine. Ascultă, întreabă, nu judeca. Vei descoperi că lumea nu e alb-negru.

6. Fii conștient de rolul tău

Tu alegi ce urmărești. Tu creezi algoritmul care te „hrănește”. Fii mai atent la ce dai like sau ce salvezi. Ai mai mult control decât crezi.

Algoritmii nu sunt „dușmani”, dar nici prieteni. Sunt unelte. Și ca orice unealtă, pot construi sau pot distruge, în funcție de cum sunt folosiți.

– Dacă nu înveți cum funcționează algoritmul, riști să devii victima lui.

– Dacă îl înțelegi, devii liber. În gândire. În alegere. În informare.

Educația media nu e un moft. E o superputere. Și puterea începe cu o simplă întrebare: „De ce văd asta acum?”

Articol realizat de Handăr Mădălina-Maria, elevă la Liceul Teoretic Iulia Hașdeu Lugoj, în urma participării în programul de educație media „Fii Informat, Nu Influențat!” derulat de Adfaber și finanțat prin programul Efectiv Civic, dezvoltat de FDSC – Fundația pentru Dezvoltarea Societății Civile în parteneriat cu RAF – Romanian American Foundation și cu sprijinul CJI – Centrul pentru Jurnalism Independent.

➡️ Mai multe despre programul „Fii Informat, Nu Influențat!” și alte materiale realizate de elevii din România pe 👉 adfaber.org/fii-informat-nu-influentat

About Adfaber

ADFABER.org is a nonprofit organization dedicated to enhancing the digital skills of students and teachers in public schools. Every year, they organize initiatives that promote the integration of technology into the educational process, playing a significant role in shaping the future IT talents.

Despre „Fii Informat, Nu Influențat!”

„Fii Informat, Nu Influențat” este un program care încurajează gândirea critică, curiozitatea și implicarea tinerilor în combaterea manipulării și în promovarea unui consum de media conștient.